英伟达(Nvidia)GPU技术大会(GTC)如期举行。这也是英伟达时隔五年首次让年度 GTC 会议重回线下,被认为是一次重要的 AI 盛会。

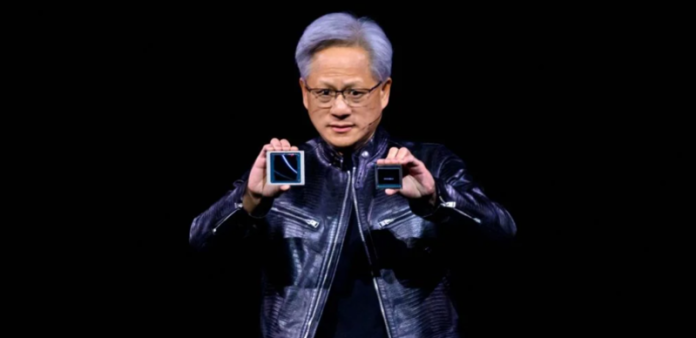

英伟达 CEO 黄仁勋在英伟达GPU技术大会(GTC)上宣布推出新一代 AI 芯片架构 Blackwell,无论是性能还是功耗较上一代实现了全面超越。

根据介绍,Blackwell 平台可以构建和运行实时生成式 AI,能够在万亿参数级的大型语言模型(LLM)上运行,成本和能耗比前身低 25 倍。

他进一步表示,新一代的 B200 GPU 拥有 2080 亿个晶体管,可以提供高达 20 petaflops 的 FP4 性能。相比之下,H100 仅为 4 petaflops。此外,将两个 B200 GPU 与单个 Grace CPU 结合在一起的 GB200,可以为 LLM 推理工作负载提供 30 倍的性能,并且显著提高效率。

黄仁勋说,训练一个 1.8 万亿个参数的模型以前需要 8 000 个 Hopper GPU 和 15 兆瓦的电力。如今,2 000 个 Blackwell GPU 就能完成这项工作,耗电量仅为 4 兆瓦。

他指出,许多企业预计将采用 Blackwell,如亚马逊网络服务、戴尔、谷歌、Meta、微软、OpenAI、甲骨文、特斯拉和 xAI。Blackwell 支持构建实时生成式 AI。黄仁勋认为,Blackwell 将成为英伟达最成功的产品发布。

此外,英伟达宣布在其企业软件订阅中增加一款名为 NIM 的新产品。NIM 可以更容易地使用旧的英伟达 GPU 进行推理,允许公司继续使用已拥有的数亿个英伟达 GPU。这将减少新人工智能模型的初始训练推理所需的算力。英伟达的策略是让购买英伟达服务器的客户注册英伟达企业版,每个 GPU 每年收取 4 500 美元的费用。

自 OpenAI 的 ChatGPT 于 2022 年末掀起人工智能热潮以来,英伟达的股价上涨了五倍,总销售额增长了两倍多。英伟达的高端服务器 GPU 对于训练和部署大型 AI 模型至关重要。

资料来源:综合报道;图片来源:英伟达官网视频截图